Per decenni il traffico organico è stato il parametro attorno a cui ruotava l’intera strategia di visibilità digitale. Più visite dal motore di ricerca significavano più opportunità di conversione, e ogni posizione guadagnata in SERP si traduceva in un incremento misurabile di sessioni sul sito.

Oggi stiamo assistendo a una trasformazione nel comportamento degli utenti che sta ridisegnando il ruolo stesso dei motori di ricerca.

Cos’è la ricerca zero click e perché sta trasformando il mercato

La ricerca zero click descrive il fenomeno per cui l’utente ottiene la risposta che cercava direttamente nella pagina dei risultati, senza mai raggiungere un sito esterno. Non si tratta di una novità assoluta — i featured snippet e i Knowledge Panel di Google esistono da anni — ma la sua portata è cambiata radicalmente con l’introduzione delle sintesi generate dall’intelligenza artificiale. Oggi circa il 60% delle ricerche su Google si conclude senza alcun click verso il web aperto. Quando l’utente accede alla modalità AI Mode, questa percentuale supera il 93%: la conversazione con l’algoritmo sostituisce interamente la navigazione tradizionale tra i risultati.

Le implicazioni per chi misura la propria salute digitale attraverso il volume di traffico organico sono significative. Il CTR e le sessioni sul sito rimangono metriche utili ma non più sufficienti a rappresentare il reale peso di un brand nell’ecosistema informativo. In alcuni settori — salute, finanza personale, definizioni, ricerche enciclopediche — il calo di traffico organico stimato si colloca tra il 15% e il 25%, con punte più alte per i contenuti che rispondono a domande semplici e dirette. Eppure, nello stesso periodo, le impressioni del brand sono aumentate: i contenuti aziendali vengono estratti, sintetizzati e presentati agli utenti su scala molto più ampia di quanto il traffico referral lasci intuire.

Questo è il paradosso che definisce il momento attuale: visibilità crescente, traffico decrescente. L’intelligenza artificiale estrae valore dai contenuti per offrire risposte immediate, educando l’utente a non lasciare l’interfaccia di ricerca. Il brand viene menzionato, la sua autorevolezza viene implicitamente confermata dalla selezione algoritmica, ma la visita al sito non avviene. Per molte aziende abituate a ragionare in termini di sessioni e rimbalzi, questo scenario è disorientante. Per quelle in grado di rileggere le proprie metriche, apre una prospettiva diversa.

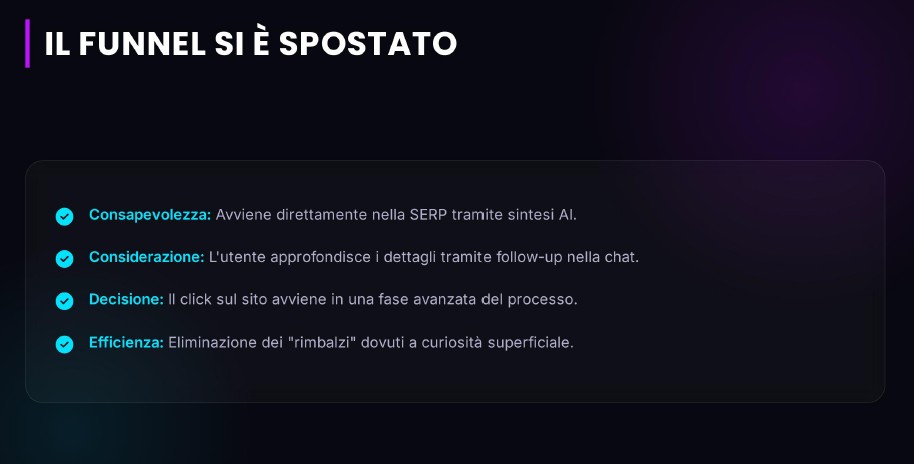

Chi clicca oggi lo fa con un’intenzione più matura. Avendo già ricevuto una risposta parziale o sintetica dal motore, l’utente che sceglie comunque di approfondire su un sito specifico è nella maggior parte dei casi in una fase avanzata del proprio processo decisionale. I dati mostrano tassi di conversione fino a cinque volte superiori rispetto al traffico generico del passato: meno visite, ma più qualificate. Il funnel non si è accorciato — si è spostato in parte all’interno dell’interfaccia del motore.

Il nuovo obiettivo non è semplicemente portare traffico al sito, ma diventare la fonte che l’intelligenza artificiale seleziona e cita nel momento in cui un utente pone una domanda rilevante per il proprio business. Questa logica — che il settore sta convergendo a chiamare economia della citazione — sposta il centro di gravità della strategia di contenuto dalla visibilità nei risultati tradizionali all’autorevolezza riconosciuta dai sistemi generativi. Essere citati da un’AI durante il processo decisionale di un potenziale cliente vale, in termini di influenza, quanto o più di una posizione in prima pagina su Google: la selezione è già avvenuta, il filtro è già passato, il brand è già stato validato da un intermediario che l’utente percepisce come neutro e affidabile.

Dall’AI Overview all’AI Mode di Google

Comprendere come Google stia ridisegnando la propria interfaccia è indispensabile per qualsiasi imprenditore che voglia mantenere rilevanza digitale nei prossimi anni. La trasformazione non è graduale — è strutturale, e si articola in due strumenti distinti che operano con logiche diverse ma convergono verso lo stesso obiettivo: trattenere l’utente all’interno dell’ecosistema Google il più a lungo possibile.

Le AI Overviews rappresentano il primo livello di questa trasformazione. Compaiono nella parte superiore della SERP e aggregano informazioni estratte da più fonti per restituire una sintesi immediata della risposta cercata. La loro presenza spinge il tasso di ricerche zero click verso l’83%: quando la risposta è già lì, visibile e ben strutturata, la motivazione a cliccare su un risultato organico si riduce drasticamente. I link citati all’interno della sintesi ricevono interazioni in meno del 19% dei casi — una percentuale che ridimensiona l’attrattiva di essere tra le fonti selezionate in termini di traffico diretto, pur confermando il valore in termini di autorevolezza percepita.

L’AI Mode è il secondo livello, e il più radicale. Lanciata in fase beta nel marzo 2025 e alimentata dal modello Gemini, non si sovrappone alla struttura tradizionale dei risultati — la elimina. Al posto dei dieci link blu subentra un’interfaccia conversazionale end-to-end in cui ogni domanda genera una risposta elaborata e ogni risposta può diventare il punto di partenza per un approfondimento successivo, senza mai uscire dall’ambiente Google. Il meccanismo tecnico che rende possibile questa esperienza è il query fan-out: il sistema lancia simultaneamente fino a sedici ricerche su sottotemi correlati, elabora i risultati in parallelo e li sintetizza in un’unica risposta coerente. È un processo invisibile all’utente ma con conseguenze molto concrete per i publisher: il 93% delle sessioni in AI Mode si conclude senza alcun click verso l’esterno.

Dal gennaio 2026 Google ha introdotto un collegamento diretto tra i due strumenti, che consente di transitare con un singolo tocco da una AI Overview a una conversazione approfondita in AI Mode. Questo passaggio trasforma il percorso informativo dell’utente in un imbuto sempre più chiuso: si entra con una domanda generica, si approfondisce attraverso il dialogo con Gemini, si ottengono raccomandazioni e confronti — tutto senza mai raggiungere un sito esterno. Il sito web aziendale, in questo schema, non è più la destinazione ma la fonte: un repository da cui l’intelligenza artificiale estrae dati per costruire le proprie risposte.

La conseguenza più rilevante per chi gestisce una strategia SEO riguarda la sovrapposizione tra visibilità tradizionale e visibilità generativa. Solo il 32% degli URL citati nelle risposte di AI Mode coincide con i primi dieci risultati della ricerca classica sullo stesso termine.

Questo dato ha implicazioni precise: essere in prima pagina su Google non garantisce più di essere presenti nelle risposte conversazionali che sempre più utenti ricevono al posto di quella prima pagina. I criteri di selezione delle fonti nei sistemi generativi seguono logiche parzialmente diverse dalla SEO tradizionale — peso maggiore all’autorevolezza tematica, alla struttura del contenuto, alla chiarezza delle risposte a domande specifiche — e chi non adegua la propria strategia a questi nuovi parametri rischia di diventare invisibile proprio nel momento in cui il mercato si muove verso questi formati.

Perché meno click possono significare lead migliori?

Il calo del traffico organico è un dato reale, ma letto senza contesto porta a conclusioni sbagliate. La metrica che conta non è il numero di sessioni — è il valore commerciale di ciascuna di esse. E su questo fronte, il quadro che emerge dai dati più recenti è controintuitivo rispetto alla narrativa del declino: meno visite, ma visite significativamente più redditizie.

Il meccanismo è quello di un filtro applicato a monte. Quando un utente riceve una sintesi generativa su Google e decide comunque di cliccare verso un sito specifico, ha già attraversato una fase di valutazione che in passato avveniva sul sito stesso — o non avveniva affatto, generando rimbalzi e sessioni senza valore. Chi arriva oggi da una AI Overview o da una risposta in AI Mode ha già incontrato il brand come fonte autorevole, ha già ricevuto una risposta parziale che ha confermato la rilevanza del contenuto, e ha scelto deliberatamente di approfondire. Questo profilo di visitatore converte a tassi che in alcuni settori raggiungono moltiplicatori di venti o più rispetto al traffico organico generico del passato.

La conseguenza diretta è una ristrutturazione del funnel di marketing. Le fasi tradizionalmente più costose — awareness e consideration — vengono ora gestite in parte dall’intelligenza artificiale, che presenta il brand, ne sintetizza la proposta di valore e costruisce una familiarità preliminare senza che l’azienda sostenga costi diretti per quella prima esposizione. Il sito riceve l’utente in una fase già avanzata del processo decisionale: non deve più convincere della propria esistenza, ma rispondere a un’intenzione già formata. Questo comprime i cicli di vendita e riduce il numero di touchpoint necessari per portare un prospect alla conversione.

Per leggere correttamente questo scenario è necessario aggiornare il sistema di misurazione. Un dashboard che mostra un calo del 20% nelle sessioni organiche, letto senza accompagnarlo dai dati di conversione e di valore medio per sessione, porta a decisioni strategiche errate — tagli al contenuto, riduzione degli investimenti SEO, ricerca affannosa di volumi alternativi. Se invece le conversioni tengono o crescono mentre il traffico scende, il segnale è opposto: la strategia sta funzionando nell’ecosistema nuovo, non in quello vecchio. Il fatturato per sessione è la metrica che sostituisce il volume come indicatore primario di salute della presenza organica.

C’è anche una dimensione meno quantificabile ma strategicamente rilevante: l’effetto reputazionale della citazione ripetuta. Un brand che viene selezionato sistematicamente come fonte nelle risposte generative di Google costruisce nel tempo una forma di autorità implicita che non ha un equivalente diretto nel modello SEO tradizionale. L’utente non ricorda necessariamente di aver cliccato su un risultato in terza posizione, ma ricorda che ogni volta che Google gli ha risposto su un certo argomento, quella risposta proveniva dalla stessa fonte. Questo accumulo di esposizioni coerenti genera un riconoscimento del brand che si traduce in preferenza diretta nelle fasi successive del processo d’acquisto — ricerche branded, accessi diretti, tassi di riacquisto più alti. Sono effetti che i modelli di attribuzione standard faticano a catturare, ma che rappresentano una parte crescente del valore reale generato dalla visibilità organica nell’era generativa.

Strategie pratiche per la visibilità nell’era dell’AI

La Generative Engine Optimization e l’Answer Engine Optimization non sono varianti sofisticate della SEO tradizionale — sono discipline con obiettivi, metriche e logiche di contenuto fondamentalmente diversi. La SEO classica punta a conquistare una posizione in una lista di risultati. La GEO punta a diventare la fonte che un sistema di intelligenza artificiale seleziona quando sintetizza una risposta per un utente. Il campo di gioco è cambiato, e con esso le regole di ingaggio. Le ricerche più recenti stimano che l’applicazione sistematica di tecniche GEO possa incrementare la visibilità nelle risposte AI fino al 40% — un margine che giustifica ampiamente un riorientamento strategico.

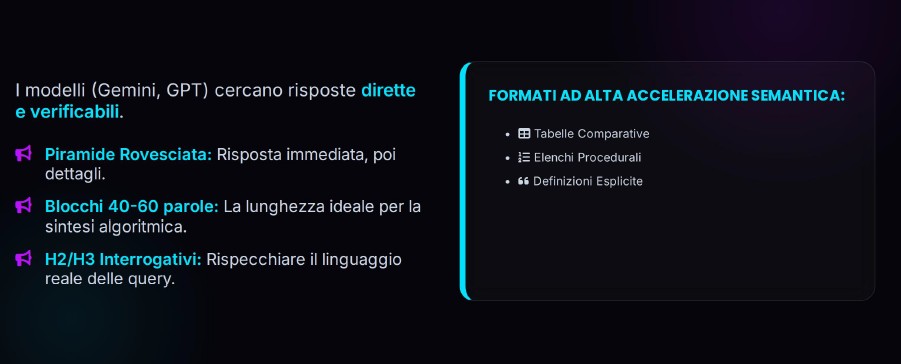

Il primo principio operativo riguarda la struttura del contenuto. I modelli linguistici di grandi dimensioni — i LLM che alimentano Gemini, ChatGPT e Copilot — elaborano il testo con una logica estrattiva: cercano la risposta più diretta e verificabile alla domanda posta, privilegiando i contenuti che la forniscono immediatamente senza richiedere interpretazioni. La struttura a piramide rovesciata risponde a questa esigenza: ogni sezione si apre con una risposta concisa e autonomamente comprensibile, idealmente tra le 40 e le 60 parole, seguita dai dettagli di supporto e dalle prove che ne confermano l’autorevolezza. Le intestazioni H2 e H3 devono rispecchiare il linguaggio reale delle domande degli utenti — non titoli creativi ma formulazioni interrogative esplicite, che gli algoritmi possono abbinare direttamente alle query. Tabelle comparative, elenchi procedurali numerati e definizioni esplicite accelerano ulteriormente la comprensione semantica del contenuto da parte dei sistemi generativi.

Sul piano tecnico, l’implementazione dei dati strutturati in formato JSON-LD assume in questo contesto una funzione diversa rispetto alla SEO tradizionale. Non si tratta di migliorare l’aspetto di un risultato in SERP, ma di definire con precisione le entità aziendali e le relazioni tra concetti nel Knowledge Graph di Google. Un aspetto specifico e spesso trascurato è l’ottimizzazione delle entità attraverso l’attributo “sameAs” nello schema: collegare esplicitamente il brand, i suoi fondatori e i suoi prodotti a profili verificabili su piattaforme esterne — Wikipedia, LinkedIn, Wikidata, Crunchbase — consente ai sistemi di intelligenza artificiale di triangolare l’identità dell’azienda attraverso fonti indipendenti, aumentando il livello di fiducia algoritmica assegnato al dominio. Questo processo di ancoraggio semantico è ciò che trasforma un sito da fonte generica a entità riconosciuta e preferita nei processi di sintesi generativa.

La qualità del contenuto nell’era GEO si misura sulla capacità di offrire ciò che i modelli linguistici non possono produrre autonomamente. Dati proprietari, ricerche originali condotte internamente, case study documentati con risultati specifici, prospettive di prima mano su fenomeni di settore: sono questi gli elementi che rendono un contenuto indispensabile per le sintesi AI, perché rappresentano informazioni che non esistono altrove nell’indice. Un articolo che rielabora nozioni già disponibili in mille altre forme non ha ragione di essere selezionato come fonte. Un’analisi che porta dati nuovi o un punto di vista verificato e non replicabile altrove diventa invece un asset difficilmente sostituibile. I segnali E-E-A-T — Esperienza, Competenza, Autorevolezza, Affidabilità — che Google ha codificato nelle proprie linee guida per i quality rater sono oggi anche i criteri impliciti con cui i sistemi generativi valutano l’affidabilità di una fonte.

La visibilità GEO non si costruisce però solo sul sito proprietario. Gli algoritmi generativi estraggono informazioni e formano valutazioni attingendo a un ecosistema molto più ampio: forum, community, piattaforme di recensione, video, discussioni sui social. Presidiare Reddit con contributi genuini e informativi, mantenere un canale YouTube con contenuti che rispondono a domande specifiche del settore, accumulare recensioni qualitative su piattaforme come G2 o Capterra significa moltiplicare i punti di contatto attraverso cui i modelli linguistici incontrano il brand. Quando più fonti indipendenti convergono verso la stessa valutazione positiva di un’azienda o di un prodotto, il sistema generativo la interpreta come un segnale di consenso che aumenta la probabilità di citazione.

Misurare il successo di una strategia GEO richiede infine un sistema di metriche aggiornato. Il CTR e il volume di sessioni organiche restano indicatori utili ma parziali. I parametri che completano il quadro sono la Share of Voice nelle risposte AI — la percentuale di query rilevanti per il proprio settore in cui il brand viene citato — la frequenza delle menzioni nelle sintesi generative e la crescita delle ricerche branded, che segnala un aumento della familiarità con il brand indipendente dai click diretti. Quest’ultimo indicatore è particolarmente significativo: un incremento nelle ricerche del nome aziendale o dei prodotti specifici è spesso la traccia misurabile di un’esposizione avvenuta nelle risposte AI, dove l’utente ha incontrato il brand, ne ha memorizzato il nome e ha scelto successivamente di cercarlo direttamente.

Formattazione tecnica: liste, tabelle e FAQ

Nel momento in cui i motori di ricerca diventano motori di risposta, la formattazione del contenuto smette di essere una questione stilistica e diventa una decisione strategica con impatto diretto sulla visibilità. Gli algoritmi generativi non leggono un articolo dall’inizio alla fine come farebbe un essere umano: lo scansionano cercando blocchi di informazione autonomamente comprensibili, estraibili senza perdita di significato e riproducibili in un formato sintetico. Chi struttura i propri contenuti pensando a questa logica estrattiva ha un vantaggio concreto rispetto a chi scrive esclusivamente per il lettore umano.

Le sezioni FAQ rappresentano lo strumento editoriale più direttamente allineato a questa esigenza. Una domanda esplicita seguita da una risposta contenuta entro sessanta parole è esattamente la struttura che i Large Language Models cercano quando devono sintetizzare una risposta su un argomento specifico. Questo formato intercetta i box “People Also Ask” nella SERP tradizionale e aumenta significativamente la probabilità di essere selezionati nelle AI Overviews, perché offre all’algoritmo un’unità di contenuto già confezionata che non richiede rielaborazione. La chiave è che ogni risposta sia autonoma: deve avere senso anche senza leggere la domanda precedente o il paragrafo successivo, perché l’intelligenza artificiale potrebbe estrarre quel blocco e presentarlo in un contesto completamente diverso da quello originale.

Le tabelle assolvono una funzione diversa ma complementare. Quando l’utente esprime un intento commerciale o comparativo — “qual è la differenza tra X e Y”, “quale soluzione è più adatta a” — i sistemi generativi privilegiano le fonti che hanno già organizzato l’informazione in forma relazionale. Una tabella con intestazioni chiare, valori coerenti e categorie di confronto esplicite consente alla macchina di mappare le relazioni tra entità in modo preciso, riducendo il margine di interpretazione e quindi il rischio di errori nella sintesi. Questo è particolarmente rilevante per i contenuti B2B, dove le decisioni d’acquisto coinvolgono confronti tra specifiche tecniche, fasce di prezzo e caratteristiche funzionali: una matrice di compatibilità ben costruita può diventare la fonte privilegiata per una categoria intera di query comparative.

Le liste numerate, infine, dominano le query procedurali. Quando un utente chiede come fare qualcosa, i modelli linguistici cercano sequenze logiche ordinate, dove ogni passaggio è breve, indipendente dagli altri e privo di digressioni narrative. Una guida passo-passo scritta in prosa discorsiva, per quanto ben redatta, è strutturalmente meno estraibile di una sequenza numerata con azioni concrete e verificabili. Lo schema HowTo in JSON-LD aggiunge un livello tecnico a questa struttura, fornendo all’algoritmo i metadati necessari per attivare i risultati arricchiti nella SERP e per alimentare gli assistenti vocali che leggono le istruzioni ad alta voce — un canale dove la fonte non viene quasi mai citata visivamente, ma dove la selezione del contenuto dipende interamente dalla qualità della sua struttura.

Il punto cruciale è che questi tre formati — FAQ, tabelle e liste — non sono soluzioni alternative tra cui scegliere, ma strumenti complementari da distribuire strategicamente in base all’intento della query che si vuole intercettare. Un contenuto che li integra in modo coerente con la logica del proprio settore non si limita a presidiare la SERP tradizionale: costruisce un’architettura informativa che i sistemi generativi possono smontare, ricombinare e presentare in mille contesti diversi, moltiplicando la superficie di visibilità ben oltre ciò che un singolo posizionamento organico potrebbe garantire.

Google Discover

Google Discover è uno dei canali di acquisizione del traffico più sottovalutati nel dibattito sulla ricerca zero click, probabilmente perché sfugge alla logica tradizionale della SEO: non esiste una query da intercettare, non c’è una SERP da scalare, non si risponde a una domanda esplicita. Discover funziona al contrario — è Google che decide proattivamente quale contenuto mostrare a ciascun utente nel proprio feed, basandosi sulla storia delle ricerche, sugli interessi inferiti dal comportamento e sulle interazioni precedenti con contenuti simili. In un ecosistema dove le ricerche attive generano sempre meno traffico verso i siti esterni, Discover rappresenta una delle poche superfici in cui il click verso il sito rimane l’unica azione possibile: non esiste una sintesi generativa che trattenga l’utente, non esiste un Knowledge Panel che risponda al posto del contenuto. O si clicca, o si scorre oltre.

Questa caratteristica strutturale lo rende strategicamente prezioso proprio nel momento in cui le AI Overviews e l’AI Mode erodono il traffico proveniente dalle ricerche tradizionali. I volumi che Discover può generare sono tutt’altro che marginali: per i siti editoriali e i blog aziendali ben posizionati tematicamente, il feed di Google può rappresentare una quota significativa del traffico totale, con picchi che in alcuni casi superano quello organico da ricerca. La variabilità è alta — Discover premia i contenuti a ondate, non con continuità lineare — ma la direzione strategica è chiara: presidiare questo canale significa accedere a un flusso di traffico che le dinamiche zero click non intaccano.

Per comparire nel feed, i segnali rilevanti divergono parzialmente da quelli della SEO classica. Il markup Article e NewsArticle in formato JSON-LD è una condizione tecnica necessaria: comunica a Google la natura editoriale del contenuto, la data di pubblicazione, l’autore e l’entità responsabile, informazioni che l’algoritmo utilizza per valutare la freschezza e l’attribuzione del pezzo. Le immagini di alta qualità con larghezza minima di 1200 pixel sono un requisito esplicito nelle linee guida di Google per l’eligibilità a Discover: contenuti privi di immagini pertinenti e ottimizzate vengono sistematicamente esclusi dal feed. L’intestazione deve essere informativa e capace di generare curiosità senza scadere nel clickbait — un equilibrio delicato, perché Google penalizza i titoli che promettono più di quanto il contenuto mantenga, misurandolo attraverso i segnali di comportamento dell’utente dopo il click.

La tematica del contenuto deve essere coerente con un’identità editoriale riconoscibile. Discover non funziona bene con siti che pubblicano su argomenti eterogenei senza una specializzazione chiara: l’algoritmo fatica a costruire un profilo tematico del dominio e a identificare gli utenti per cui quel contenuto è rilevante. Chi ha investito nella costruzione di autorevolezza verticale su un settore specifico — esattamente il tipo di posizionamento che favorisce anche la GEO — si trova avvantaggiato anche su questo canale, perché Google riesce a distribuire il contenuto con maggiore precisione agli utenti con interessi affini.

C’è infine una dimensione temporale da considerare. Discover premia la freschezza, ma non nel senso delle notizie di cronaca: premia i contenuti che affrontano temi di interesse duraturo con un’angolazione nuova, un aggiornamento significativo o un dato originale che giustifichi la riproposizione. Un articolo evergreen aggiornato con nuove statistiche o con un caso studio recente può rientrare nel feed con la stessa efficacia di un contenuto appena pubblicato. Questa logica di aggiornamento continuativo dei contenuti esistenti, già raccomandata per la SEO tradizionale e per la GEO, produce quindi un effetto moltiplicatore anche su Discover — tre obiettivi strategici serviti da un’unica pratica editoriale.

Come adattare il funnel di marketing e il modello di contenuto

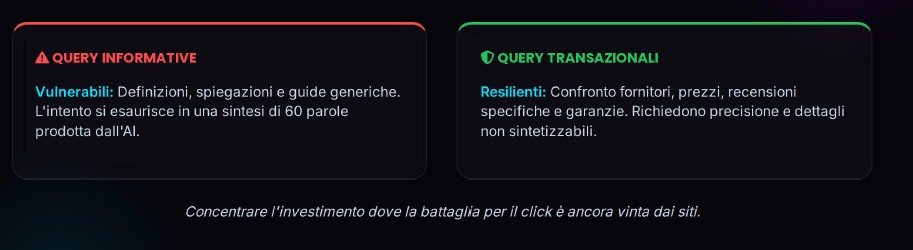

Non tutte le query subiscono allo stesso modo la pressione dello zero click. Le ricerche di tipo informativo — definizioni, spiegazioni, guide generiche — sono le più vulnerabili alla cannibalizzazione da parte delle AI Overviews, perché il loro intento si esaurisce in una risposta sintetica. Le ricerche transazionali e commerciali si comportano in modo strutturalmente diverso: chi sta valutando un acquisto, confrontando fornitori o cercando una soluzione specifica a un problema operativo ha bisogno di dettagli che una sintesi di sessanta parole non può contenere. Tabelle di prezzo aggiornate, configuratori di prodotto, recensioni verificate con casi d’uso specifici, politiche di garanzia — sono informazioni che richiedono una visita al sito e che Google non può sintetizzare senza perdere la precisione che l’utente in quella fase richiede. Concentrare gli investimenti editoriali su questi segmenti significa scegliere il terreno dove la battaglia per il click è ancora vinta dai siti e non dai motori.

Focus sulle query transazionali e commerciali

Questa logica suggerisce una revisione della mappa dei contenuti in base alla resistenza allo zero click di ciascuna categoria di query. Un audit che classifichi i contenuti esistenti per intento — informativo, navigazionale, commerciale, transazionale — e misuri per ciascuno il CTR effettivo nel periodo successivo all’introduzione delle AI Overviews restituisce una fotografia precisa di dove il traffico si sta erodendo e dove invece tiene. Le risorse editoriali future vanno riorientate di conseguenza, riducendo la produzione di contenuti informativi generici che alimentano le sintesi AI senza generare visite, e aumentando quella di contenuti ad alto intento commerciale che mantengono una ragione concreta per il click.

Il secondo fronte riguarda gli strumenti che solo il sito può offrire. L’intelligenza artificiale di Google può rispondere a domande, ma non può eseguire un calcolo personalizzato sul budget di un utente specifico, non può generare un preventivo su misura, non può restituire un’analisi basata sui dati che l’utente inserisce in tempo reale. Calcolatori di ROI, configuratori interattivi, tool di diagnostica, simulatori di risparmio: questi strumenti creano un motivo strutturale per abbandonare l’ecosistema chiuso del motore di ricerca e stabilire un contatto diretto con il sito. Non sono semplici contenuti — sono servizi che producono un output personalizzato, e per questo sono intrinsecamente non sintetizzabili. Rappresentano oggi una delle forme più efficaci di differenziazione in un mercato dove i contenuti testuali standard vengono progressivamente assorbiti dalle risposte generative.

White paper basati su ricerche proprietarie, casi studio con dati verificabili e testimonianze strutturate svolgono una funzione analoga sul piano della profondità: offrono un livello di dettaglio e di specificità che giustifica la visita e che, una volta sul sito, converte con tassi significativamente superiori al traffico informativo. La logica sottostante è che il sito smette di essere il luogo dove l’utente inizia a informarsi e diventa il luogo dove conclude un processo decisionale già avviato altrove. Questo riposizionamento del ruolo del dominio aziendale non è una resa alla ricerca zero click — è la risposta strategica più razionale a un ecosistema che ha spostato la fase educativa dentro il motore di ricerca, lasciando alle aziende la parte più preziosa del funnel: quella in cui l’intenzione si trasforma in azione.

Strategie di visibilità online oltre Google: farsi un nome con la brand awareness

Esiste una categoria di traffico che le AI Overviews non possono intercettare per definizione: quella generata da chi cerca direttamente il nome di un’azienda. La ricerca branded è l’unico segmento organico strutturalmente immune alla ricerca zero click, perché l’utente non sta cercando una risposta generica — sta cercando specificamente voi. Nessuna sintesi generativa può soddisfare quell’intento reindirizzandolo altrove. Costruire una domanda branded robusta è quindi la forma più diretta di protezione dalla cannibalizzazione algoritmica, e il suo sviluppo dovrebbe essere trattato come una priorità strategica autonoma, separata dalla SEO tradizionale.

Il volume delle ricerche branded non cresce per caso: è il risultato accumulato di ogni punto di contatto in cui il pubblico ha incontrato il nome dell’azienda e lo ha memorizzato. In questo senso, la visibilità zero click — essere citati nelle AI Overviews, comparire nei Knowledge Panel, essere menzionati nelle risposte di Copilot — svolge una funzione che assomiglia più alla pubblicità display che alla SEO classica. L’utente non clicca, ma registra. La familiarità si accumula silenziosamente, e quando il bisogno diventa abbastanza urgente da giustificare una ricerca attiva, il nome che emerge spontaneamente è quello che ha guadagnato più esposizioni coerenti nel tempo. Misurare la crescita del volume branded nel periodo successivo all’aumento delle citazioni AI è uno dei modi più affidabili per quantificare il valore reale di una strategia GEO, al di là dei click diretti.

Presidiare il proprio Knowledge Panel è la controparte tecnica di questo lavoro. Il pannello di conoscenza che appare nella colonna destra della SERP quando qualcuno cerca il nome dell’azienda è costruito da Google attingendo a fonti che considera autorevoli e verificabili: Wikipedia, Wikidata, il sito ufficiale, i profili sui social network, le directory di settore. Rivendicare e verificare il Knowledge Panel attraverso Google Search Console consente di correggere informazioni errate e di aggiungere dettagli che Google non ha recuperato autonomamente. Una voce Wikipedia ben strutturata, quando giustificata dalla notorietà effettiva dell’azienda, è tra i segnali più potenti per consolidare la scheda e per garantire che le informazioni mostrate siano accurate — un aspetto critico in un ecosistema dove i sistemi AI attingono a queste fonti per costruire le proprie risposte sulle entità aziendali.

Diversificare i canali: newsletter, social e YouTube

La diversificazione dei canali di acquisizione merita invece una riflessione che va oltre la semplice lista di alternative a Google. Il principio sottostante è la proprietà del canale: ogni piattaforma su cui un’azienda costruisce la propria audience senza possedere il rapporto diretto con essa è un asset a rischio. Gli aggiornamenti algoritmici di Google, le modifiche alle policy di LinkedIn, i cambiamenti nella visibilità organica di YouTube sono eventi fuori dal controllo dell’azienda ma con impatto diretto sul suo traffico. La newsletter è l’unico canale dove questo rischio è strutturalmente assente: il database di contatti appartiene all’azienda, la consegna non dipende da un algoritmo terzo e il rapporto con il lettore è diretto e continuativo. Un database di iscritti costruito nel tempo con contenuti di qualità è un asset che si rivaluta progressivamente, indipendentemente da ciò che accade nell’ecosistema della ricerca. In un periodo in cui la volatilità algoritmica è destinata ad accelerare con l’evoluzione dei sistemi generativi, spostare progressivamente una quota del proprio pubblico verso canali proprietari è una delle decisioni più razionali che un imprenditore possa prendere oggi.

L’evoluzione della SEO con le ricerche zero click: le opportunità per chi si evolve

Google ha smesso di essere un intermediario neutro che indirizza il traffico verso i migliori contenuti — è diventato un competitore diretto per l’attenzione dell’utente. Riconoscere questa realtà con lucidità è il primo passo per smettere di costruire strategie che puntano a recuperare un modello che non tornerà.

La risposta più matura a questo scenario non è difensiva ma fondativa: costruire un brand che le persone cercano attivamente, indipendentemente da ciò che Google decide di mostrare o sintetizzare. Le aziende che escono indenni dalle trasformazioni algoritmiche — e la storia del web ne offre molti esempi, dai Panda e Penguin update fino alle AI Overviews — sono invariabilmente quelle che hanno investito nella profondità della relazione con il proprio pubblico piuttosto che nell’ottimizzazione di metriche che un aggiornamento può azzerare dall’oggi al domani. La dipendenza dal traffico organico è sempre stata un rischio; nell’era generativa, quel rischio è semplicemente diventato più visibile e più urgente.

Infine, vale la pena riconsiderare il significato stesso di visibilità digitale nell’era attuale. Oggi significa essere la risposta che un sistema di intelligenza artificiale fornisce quando un potenziale cliente pone una domanda rilevante per il proprio business, in qualsiasi interfaccia stia usando, su qualsiasi dispositivo, in qualsiasi momento della giornata. Questa forma di presenza non si misura in click, non si vede in un ranking tradizionale e non compare in Google Analytics — ma precede e condiziona ogni decisione d’acquisto che avviene successivamente.

Costruirla richiede competenza, coerenza e una visione che superi i cicli trimestrali di reportistica. È esattamente il tipo di investimento che distingue le aziende che dominano un mercato da quelle che lo subiscono.

Semrush per la crescita di un progetto web

Il valore di una piattaforma come Semrush in questo contesto non risiede solo nella capacità di misurare lo stato attuale, ma nell’anticipare dove si sposterà la competizione. I mercati che oggi mostrano una penetrazione bassa delle AI Overviews su determinate categorie di query sono i mercati in cui è ancora possibile consolidare una posizione prima che la saturazione generativa raggiunga quei segmenti. Avere accesso a dati granulari su come e dove l’intelligenza artificiale sta modificando la distribuzione della visibilità permette di allocare le risorse editoriali e tecniche con un orizzonte temporale più lungo — trasformando una piattaforma analitica da strumento di reportistica a strumento di pianificazione strategica.

Quando il traffico organico su una keyword cala, le cause possibili sono almeno tre: un peggioramento del posizionamento, l’intercettazione del click da parte di una AI Overview, oppure un cambiamento nell’intento di ricerca degli utenti. Confondere questi scenari porta a decisioni sbagliate — ottimizzare una pagina che performa bene ma viene semplicemente scavalcata da una sintesi generativa, o ignorare un calo reale di ranking attribuendolo erroneamente all’AI. La funzione di Position Tracking di Semrush segnala per ogni keyword monitorata la presenza di elementi SERP che intercettano l’attenzione prima dei risultati organici, consentendo una diagnosi precisa prima di qualsiasi intervento.

Lo strumento Keyword Gap, applicato alla visibilità nelle risposte AI, introduce una logica competitiva che la SEO tradizionale non contemplava. Identificare le query in cui i competitor vengono citati dai sistemi generativi mentre il proprio brand è assente non è solo un esercizio di benchmarking — è la mappa delle priorità editoriali più diretta disponibile. Ogni gap rappresenta un’area tematica in cui un altro operatore di mercato sta costruendo autorevolezza riconosciuta dall’intelligenza artificiale, e quindi influenzando le decisioni dei potenziali clienti in una fase del processo decisionale che non lascia tracce nei dati di traffico tradizionali.

Inoltre, la funzionalità di Site Audit orientata alla GEO valuta la prontezza tecnica delle pagine per l’estrazione automatica dei contenuti, con un focus specifico sulla qualità e completezza dei dati strutturati e sulla coerenza nella marcatura delle entità.