Il traffico organico rappresenta il volume di visitatori che raggiungono una piattaforma digitale attraverso i risultati naturali dei motori di ricerca, indipendentemente da qualsiasi investimento pubblicitario a pagamento. Per un imprenditore, questa metrica costituisce uno degli indicatori più attendibili della salute strutturale del proprio sito web: riflette la capacità del dominio di rispondere con coerenza e autorevolezza alle intenzioni di ricerca del pubblico target.

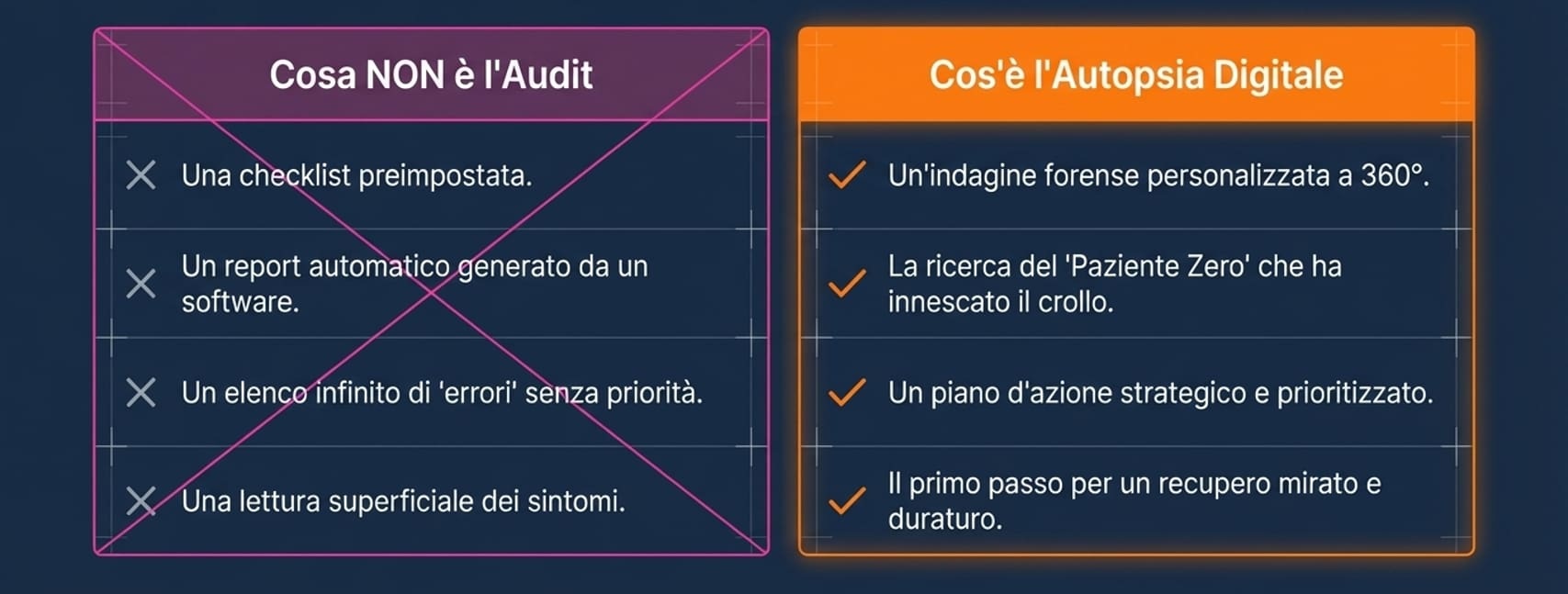

Quando questa metrica subisce una contrazione repentina, ci si trova di fronte a un’interruzione critica che esige un’analisi forense approfondita, non una verifica superficiale. Le checklist generiche, per quanto diffuse, si rivelano strumenti inadeguati in questi contesti: si limitano a registrare sintomi isolati senza intercettare le interdipendenze strutturali tra gli elementi tecnici del sito, né identificare il momento esatto in cui Google ha classificato un portale come di scarso valore.

La metodologia più efficace è in questi casi una vera e propria autopsia digitale: un approccio diagnostico che non si ferma alla superficie del problema, ma risale alla causa originaria del collasso — il cosiddetto paziente zero — ovvero l’evento, la modifica o il malfunzionamento che ha innescato la perdita di posizionamento. Questo processo richiede la capacità di interpretare il dialogo tecnico tra il server e i crawler dei motori di ricerca, decodificando segnali che spesso sfuggono a un’ispezione ordinaria.

Come riconoscere il traffico organico di un ecommerce parziale e totale

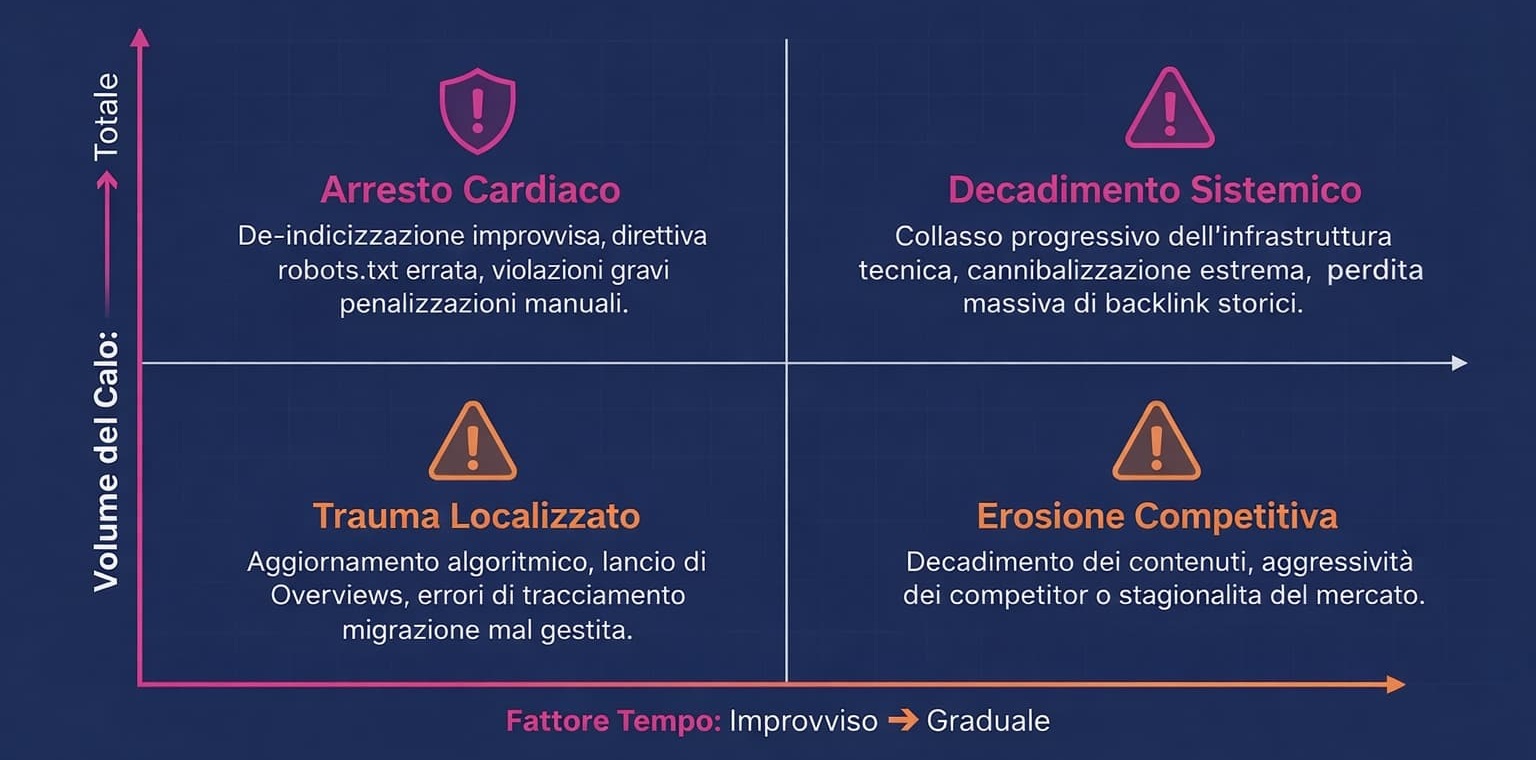

La prima distinzione fondamentale nell’analisi di un calo di traffico organico riguarda la sua entità. Quando le visite provenienti dalla ricerca organica si azzerano o si riducono a valori prossimi alla nullità, ci si trova di fronte a un calo totale: una condizione che rimanda quasi sempre a fenomeni di de-indicizzazione completa o a violazioni gravi delle linee guida dei motori di ricerca. Tra le cause tecniche più ricorrenti figura la configurazione errata del file robots.txt: l’inserimento accidentale di direttive restrittive universali può determinare la scomparsa dell’intero dominio dalle pagine dei risultati in un arco di tempo estremamente ridotto, con conseguenze immediate sul flusso di visitatori e sulla visibilità commerciale del brand.

Un calo parziale, al contrario, si manifesta attraverso perdite di visibilità circoscritte: un segmento di dispositivi — tipicamente il mobile — oppure specifiche sezioni del sito, come il catalogo prodotti o le landing page strategiche. Questo tipo di contrazione indica con frequenza la presenza di problemi tecnici localizzati o una mancata conformità a specifici criteri algoritmici, che penalizzano selettivamente alcune aree della piattaforma senza compromettere l’intero dominio.

Altrettanto determinante è la distinzione tra un declino graduale e un crollo improvviso, poiché le due dinamiche rimandano a cause profondamente diverse. Il declino progressivo è spesso riconducibile al fenomeno del content decay: i contenuti pubblicati perdono rilevanza nel tempo, man mano che evolvono gli intenti di ricerca degli utenti e che la concorrenza consolida proposte editoriali più aggiornate e autorevoli. Un crollo verticale e repentino, invece, segnala quasi sempre l’impatto diretto di un aggiornamento algoritmico o di una penalizzazione che colpisce la struttura del sito in modo immediato e sistemico.

Saper classificare correttamente la tipologia di calo prima ancora di intervenire è la condizione preliminare per qualsiasi piano di recupero efficace.

Cos’è un audit SEO e perché è importante per recuperare una perdita

Un audit SEO tecnico è una procedura diagnostica di profondità strutturale che valuta lo stato di salute complessivo di una piattaforma digitale dal punto di vista dei motori di ricerca. A differenza di una verifica basata su checklist predefinite, questo processo adotta una logica investigativa: l’obiettivo non è spuntare voci da un elenco, ma risalire alla causa originaria che ha compromesso la visibilità organica del dominio, identificando le interdipendenze tra elementi tecnici, semantici e algoritmici che una lettura superficiale non è in grado di intercettare.

La rilevanza strategica di questo processo risiede in una premessa fondamentale: nessuna strategia editoriale o di acquisizione del traffico può produrre risultati sostenibili se poggia su un’infrastruttura tecnica che ostacola la scansione, genera ambiguità nell’indicizzazione o penalizza l’esperienza utente. L’audit rappresenta quindi il presupposto di qualsiasi investimento di medio e lungo periodo, non una fase opzionale da attivare in risposta a un’emergenza.

Sul piano operativo, il processo integra l’analisi manuale del codice sorgente con l’impiego di strumenti specialistici — tra cui Screaming Frog, Semrush e Ahrefs — per la validazione empirica delle anomalie rilevate. Le macroaree di indagine comprendono l’indicizzazione, la gestione dei parametri URL, l’architettura informativa, la velocità di caricamento e il comportamento reale dei crawler, ricostruito attraverso l’analisi dei log del server. Gli output dell’analisi — il report tecnico, l’Executive Brief e la roadmap operativa — traducono le evidenze diagnostiche in priorità d’intervento ordinate per impatto potenziale sul posizionamento e sugli obiettivi di business.

L’utilità di un audit non si esaurisce nel recupero del traffico perduto: si estende alla capacità di segmentare le risorse del sito per intento di ricerca e valore economico, concentrando gli sforzi sulle pagine che contribuiscono in modo effettivo alla generazione di fatturato. È questa prospettiva — orientata al ritorno sull’investimento prima ancora che al posizionamento — a distinguere un audit SEO tecnico da una semplice verifica di conformità.

Le cause di un traffico organico

Prima di attribuire un calo di traffico a cause tecniche interne, è necessario escludere con metodo l’influenza di fattori esterni. La stagionalità, in particolare, rappresenta una variabile ricorrente che può generare fluttuazioni significative del tutto fisiologiche: un confronto dei dati storici su base annuale consente di verificare se l’andamento attuale ricalca i pattern di mercato registrati negli anni precedenti. Qualora i grafici mostrino una sovrapposizione coerente, l’ipotesi di un problema tecnico perde consistenza e l’analisi può orientarsi altrove.

Un secondo fattore esterno da considerare con la stessa attenzione è la pressione competitiva. Quando i competitor consolidano strategie digitali più strutturate — aggiornando i propri contenuti, rafforzando il profilo di backlink o migliorando l’esperienza utente — acquisiscono quote di visibilità a scapito dei domini meno reattivi. In questi casi il calo di traffico non riflette un deterioramento assoluto del sito, ma uno spostamento relativo delle posizioni all’interno di un ecosistema competitivo in evoluzione, che un’analisi della concorrenza professionale può evidenziare.

Tra le cause interne più critiche figura invece la migrazione SEO, un processo che interessa il rifacimento grafico del sito, il cambio di dominio o l’adozione di un nuovo sistema di gestione dei contenuti. Affrontare questa transizione senza una strategia tecnica definita equivale a cancellare la storia e l’autorevolezza che il dominio ha costruito nel tempo. Per scongiurare quella che può essere definita amnesia digitale, ogni URL esistente deve essere collegato alla nuova destinazione attraverso redirect 301 configurati con precisione. Questa procedura garantisce la conservazione del valore trasmesso dai backlink in entrata e impedisce la generazione massiva di errori 404, i quali degradano simultaneamente l’esperienza utente e la visibilità nelle pagine dei risultati. L’assenza di redirect corretti produce cali di traffico organico che, in molti casi, assumono carattere permanente per via della dissoluzione progressiva dell’autorità di dominio.

Come richiedere la riconsiderazione dopo una penalizzazione

Un capitolo distinto riguarda le penalizzazioni manuali, identificabili con precisione attraverso i messaggi che Google trasmette nella sezione dedicata alle azioni manuali all’interno della Search Console. Queste sanzioni vengono comminate in risposta a comportamenti che violano le linee guida del motore di ricerca: l’adozione di schemi di link artificiali, la pubblicazione di contenuti duplicati o la presenza di software malevolo all’interno della piattaforma. A differenza dei cali algoritmici — che richiedono un’interpretazione indiretta dei dati — le penalizzazioni manuali offrono un punto di partenza diagnostico esplicito, che rende più agevole la costruzione di un piano di recupero strutturato.

La richiesta di riconsiderazione costituisce una procedura formale ed esclusiva per la risoluzione delle penalizzazioni manuali notificate da Google attraverso la sezione dedicata alle azioni manuali all’interno della Search Console. Questo processo richiede un approccio improntato alla massima trasparenza, in cui il proprietario del sito deve dare prova di aver compreso pienamente le violazioni commesse e deve fornire evidenze concrete circa il lavoro di bonifica effettuato.

La documentazione delle azioni correttive deve essere estremamente dettagliata per risultare efficace. Nel caso di sanzioni dovute a profili di link artificiali, è necessario produrre un registro accurato degli sforzi compiuti per la rimozione dei collegamenti tossici, che includa screenshot delle comunicazioni inviate ai webmaster esterni e l’elenco definitivo dei link sottoposti a disconoscimento tramite il Disavow Tool. Qualora la penalizzazione derivi da contenuti scarni o duplicati, la prova del rimedio deve consistere nella dimostrazione della cancellazione delle pagine di scarso valore e nella loro sostituzione con testi originali, approfonditi e conformi ai criteri di qualità richiesti dal motore di ricerca. Se la penalizzazione è invece legata a una compromissione del sito da parte di hacker, il documento deve attestare l’avvenuta pulizia del codice malevolo e il ripristino dei protocolli di sicurezza.

Il testo della richiesta deve mantenere un tono asciutto e fattuale, privo di giustificazioni e focalizzato esclusivamente sugli interventi risolutivi che hanno riportato l’ecommerce in linea con le istruzioni per i webmaster, e sul fatto che la piattaforma ora rispetta rigorosamente ogni linea guida per prevenire eventuali recidive future.

Dopo l’invio della richiesta attraverso la Search Console, i tempi di risposta dell’attività di revisione possono variare da pochi giorni a diverse settimane. Il ripristino del traffico e delle posizioni perse avviene solitamente attraverso un recupero graduale, poiché il sistema deve rielaborare i nuovi segnali di affidabilità del dominio. I segnali positivi da monitorare con costanza includono il ritorno progressivo delle pagine chiave nelle pagine dei risultati, la crescita costante del numero di impressioni e un aumento del tasso di clic verso il sito. L’osservazione sistematica di queste metriche permette di confermare che Google ha rivalutato positivamente l’autorevolezza del brand e ha rimosso le limitazioni alla visibilità organica precedentemente imposte.

In situazioni di emergenza estrema, qualora il nuovo portale presenti difetti tecnici critici, il ricorso al rollback rappresenta l’unica opzione di tutela immediata. Il ripristino della versione precedente del sito entro poche ore dalla pubblicazione consente di limitare i danni economici e di posticipare l’operazione fino alla risoluzione definitiva dei problemi strutturali.

Gli strumenti per riconoscere un calo di traffico organico

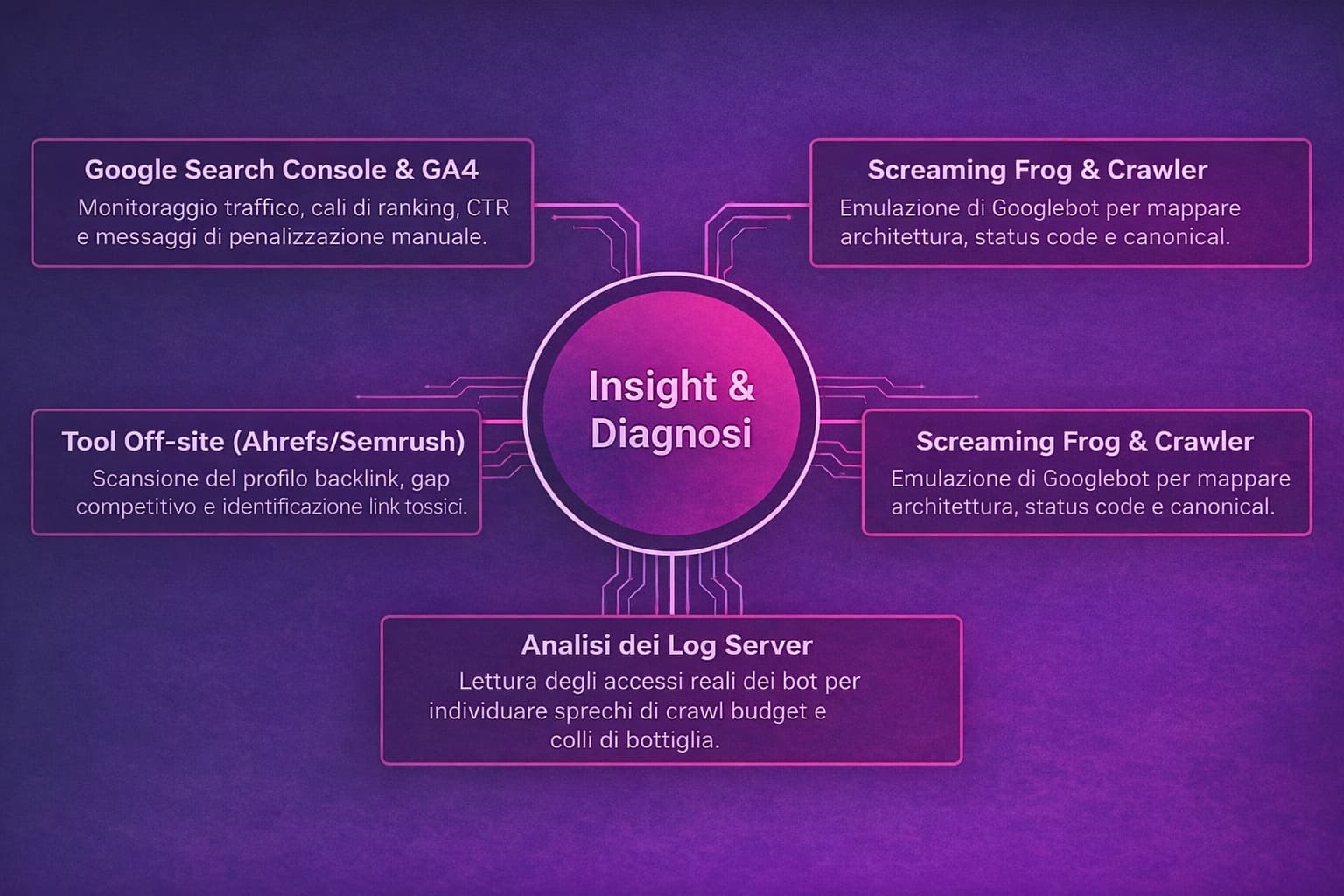

Un’analisi forense efficace di un e-commerce richiede un ecosistema di strumenti diagnostici complementari, ciascuno progettato per illuminare una dimensione specifica della piattaforma. La padronanza di questi strumenti — e soprattutto la capacità di incrociarne i dati — rappresenta il discrimine tra un’indagine superficiale e una diagnosi strutturale attendibile.

Google Search Console costituisce il canale di comunicazione diretto tra il dominio e il motore di ricerca: nessun altro strumento offre questa prospettiva privilegiata. Attraverso la Console è possibile identificare errori di scansione, URL bloccati da direttive nel file robots.txt e anomalie nello stato di indicizzazione che possono precludere la visibilità di intere sezioni del catalogo. È inoltre l’unico ambiente in cui le penalizzazioni manuali vengono notificate in modo esplicito, rendendo possibile una risposta tempestiva e documentata.

Google Analytics 4 sposta il focus dal motore di ricerca al comportamento degli utenti. Lo strumento consente di isolare le pagine che registrano contrazioni nelle performance e di distinguere con precisione un calo di interesse commerciale verso determinati prodotti da un problema di accessibilità tecnica, una distinzione che orienta in modo radicalmente diverso le priorità di intervento.

Per una mappatura completa dell’architettura del sito, strumenti come Screaming Frog simulano l’attività degli spider dei motori di ricerca, rilevando link interrotti, meta tag duplicati e incongruenze nella configurazione del protocollo HTTPS. Questi elementi, se trascurati, erodono progressivamente l’autorevolezza del dominio agli occhi di Google.

L’analisi dei log del server aggiunge una dimensione ulteriore: documenta con precisione la frequenza e le modalità con cui Googlebot interagisce con le risorse del sito, validando il comportamento reale dei crawler e mettendo in luce eventuali sprechi di crawl budget su pagine prive di valore strategico. Un budget di scansione mal distribuito può privare le pagine più rilevanti della frequenza di aggiornamento necessaria a mantenere posizioni competitive.

Un passaggio preliminare imprescindibile, spesso sottovalutato, riguarda la verifica del tracciamento: prima di interpretare qualsiasi dato, è necessario confermare che il codice di monitoraggio sia attivo e correttamente configurato su ogni pagina del sito. Un errore nel tag o una modifica non documentata al contenitore può generare l’apparenza di un crollo del traffico del tutto privo di riscontro nella realtà, inducendo analisi e interventi del tutto fuorvianti.

Semrush opera come una centrale di monitoraggio del posizionamento organico. Il suo strumento Sensor permette di determinare se una flessione del traffico derivi da un’instabilità generalizzata delle pagine dei risultati — segnale di un aggiornamento algoritmico in corso — oppure da una criticità specifica del dominio analizzato. Le funzionalità di Domain Analytics e Keyword Gap completano il quadro competitivo, evidenziando le discrepanze di visibilità rispetto ai concorrenti e identificando le opportunità di traffico non presidiate o i segmenti in cui altri operatori hanno consolidato un vantaggio strategico.

La diagnostica del profilo di backlink trova nel report Lost & Found uno strumento di sorveglianza puntuale: i collegamenti esterni persi negli ultimi novanta giorni incidono direttamente sull’autorità del dominio e sulla stabilità del ranking, spesso in modo non immediatamente percepibile dalle metriche di superficie. Il Backlink Audit tool completa questa funzione difensiva, identificando pattern di link artificiali o tossici prima che questi inneschino azioni correttive da parte di Google.

7 giorni gratis per Semrush ONE ( SEO + AI visibility in una soluzione unica )

Gli aspetti tecnici da verificare per recuperare il calo di traffico

Il file robots.txt rappresenta il primo punto di contatto tra il sito e i crawler dei motori di ricerca: è la risorsa che i bot consultano prima di qualsiasi altra per stabilire le regole di accesso all’infrastruttura. Un errore in questo documento — in particolare l’inserimento di una direttiva di blocco universale — è sufficiente a rendere l’intero dominio invisibile ai motori di ricerca nel giro di poche ore. Esistono tuttavia criticità meno evidenti ma altrettanto dannose, come il blocco involontario dei file CSS o JavaScript. Impedire ai crawler l’accesso a queste risorse compromette il rendering completo della pagina: il motore di ricerca percepisce un contenuto testuale privo di struttura visiva, che viene valutato come di bassa qualità con conseguenze dirette sul posizionamento, in particolare sui dispositivi mobili.

Il crawl budget — ovvero la quantità di risorse che Google destina alla scansione delle pagine di un dominio — richiede una gestione altrettanto rigorosa. Negli e-commerce, la proliferazione di URL generati dai filtri di navigazione, come quelli per colore, taglia o disponibilità, esaurisce rapidamente questa risorsa su una moltitudine di varianti duplicate. Ogni combinazione di parametri produce un indirizzo che Google interpreta come una pagina autonoma, innescando un fenomeno di cannibalizzazione delle parole chiave: l’autorità della risorsa principale si diluisce tra varianti in competizione reciproca, generando ambiguità nel motore di ricerca circa la versione da indicizzare e posizionare.

Lo strumento tecnico deputato a risolvere questi conflitti strutturali è il tag rel=”canonical”, che segnala in modo esplicito l’URL di riferimento al quale Google attribuisce l’intero valore SEO, consolidando i segnali di autorevolezza su un unico punto. In parallelo, la sitemap XML facilita la scoperta e l’indicizzazione dei prodotti: deve essere mantenuta aggiornata, priva di URL non indicizzabili o in errore, e inviata regolarmente attraverso gli strumenti per i webmaster.

La presenza di errori 404 e link interrotti completa il quadro delle criticità tecniche di base: comunicano ai motori di ricerca una scarsa manutenzione della piattaforma e degradano simultaneamente l’esperienza utente e la reputazione del dominio.

Sul piano dell’architettura informativa, la scelta del modello organizzativo determina tanto l’efficacia della scansione quanto la qualità dell’esperienza utente.

Una strategia di internal linking ben progettata assicura la distribuzione capillare della link equity verso le pagine prodotto strategiche e agevola la scansione sistematica del sito. L’assenza di una rete di collegamenti interni coerente produce le cosiddette pagine orfane: contenuti privi di link in entrata che Google fatica a scoprire e che, anche quando indicizzati, ricevono un’autorità insufficiente a competere nelle pagine dei risultati. Un audit periodico dei link interni consente di identificare interruzioni nel flusso di autorità e correggere i nodi morti che limitano le performance organiche del dominio.

Sul fronte del profilo di backlink, l’audit rappresenta una procedura diagnostica irrinunciabile. L’obiettivo è isolare i collegamenti provenienti da directory spam, siti non indicizzati o reti di link artificiali costruite per manipolare il PageRank — tutti elementi che espongono il dominio a penalizzazioni algoritmiche o manuali di notevole gravità. Un rischio distinto, ma correlato, è quello della negative SEO: attacchi condotti da terzi attraverso campagne di link building spam progettate per danneggiare il posizionamento del brand.

La difesa richiede un monitoraggio continuativo del profilo di collegamento esterno e, quando necessario, il ricorso al Disavow Tool di Google per la disconoscenza ufficiale dei link tossici, ripristinando la fiducia del motore di ricerca nei confronti della piattaforma.

Quali pagine eliminare per migliorare il posizionamento di un ecommerce

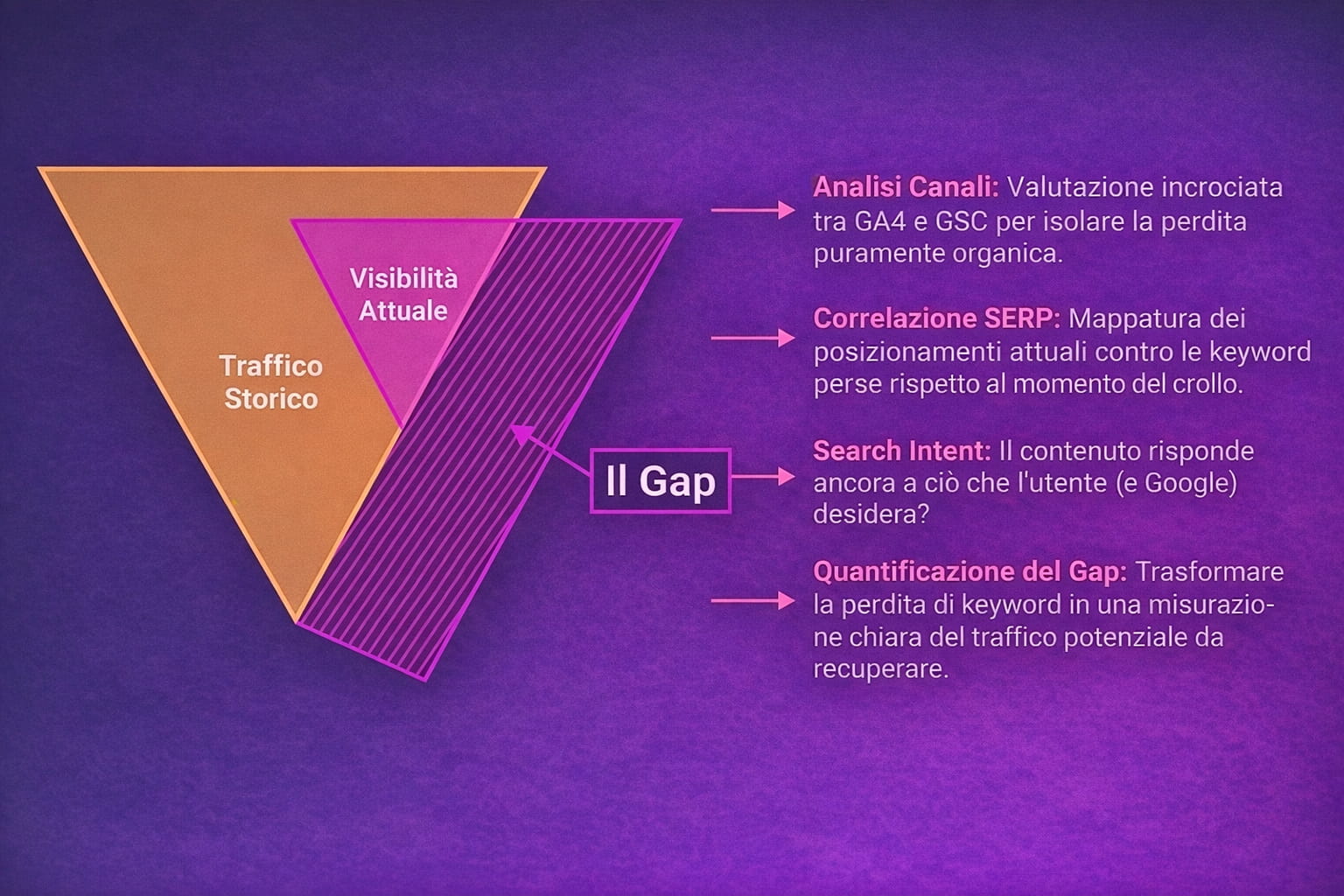

Il content decay descrive la contrazione progressiva del ranking e della visibilità organica che colpisce risorse editoriali un tempo performanti. Una pagina che ha generato traffico qualificato per anni può scivolare nelle posizioni di risultato non per una sua debolezza originaria, ma perché il contesto in cui opera si è trasformato: gli intenti di ricerca degli utenti evolvono, la concorrenza pubblica proposte più aggiornate e gli algoritmi affinano i propri criteri di valutazione. Identificare i contenuti soggetti a questo fenomeno richiede un’analisi del traffico che isoli i cluster tematici in declino, distinguendo le flessioni strutturali dalle variazioni stagionali già trattate in precedenza.

La risposta operativa al content decay passa attraverso due leve distinte: il content pruning e la re-ottimizzazione. Il pruning consiste nella rimozione o nel consolidamento strategico delle pagine ridondanti, obsolete o che non hanno mai prodotto valore misurabile per l’utente. La selezione dei contenuti da eliminare o accorpare si fonda su dati oggettivi — traffico, qualità intrinseca, attualità delle informazioni — e non su valutazioni soggettive. In molti casi, la fusione di articoli tematicamente affini in un’unica risorsa più completa risolve problemi di cannibalizzazione già citati nella sezione dedicata all’architettura tecnica, consolidando l’autorità su un singolo URL di riferimento. Il risultato è una struttura editoriale più coerente, che concentra il potenziale del dominio sulle pagine dotate di reale valore economico e informativo.

La re-ottimizzazione, invece, interviene sui contenuti che conservano una base solida ma hanno perso allineamento con le aspettative attuali del pubblico. Questo processo impone una verifica sistematica della capacità di ogni pagina di rispondere agli intenti di ricerca correnti: dove il disallineamento è evidente, l’intervento include l‘aggiornamento delle fonti, l’integrazione di dati recenti e l’aggiunta di sezioni dedicate alle domande che il pubblico target formula con maggiore frequenza.

In entrambi i casi, il parametro di riferimento per valutare la solidità di un contenuto è il framework E-E-A-T — esperienza, competenza, autorevolezza e affidabilità — che Google utilizza per valutare la qualità delle risorse editoriali in modo sempre più granulare. Rafforzare questi parametri richiede scelte editoriali precise: integrare dati proprietari, costruire casi studio di successo, esprimere punti di vista distintivi che non possano essere replicati da contenuti generati automaticamente. La trasparenza delle fonti e la coerenza degli aggiornamenti nel tempo trasmettono al motore di ricerca un segnale di affidabilità che si traduce in una maggiore resilienza di fronte agli aggiornamenti algoritmici, i cui effetti sui domini editorialmente solidi tendono a essere strutturalmente inferiori rispetto a quelli registrati da piattaforme con contenuti superficiali o generici.

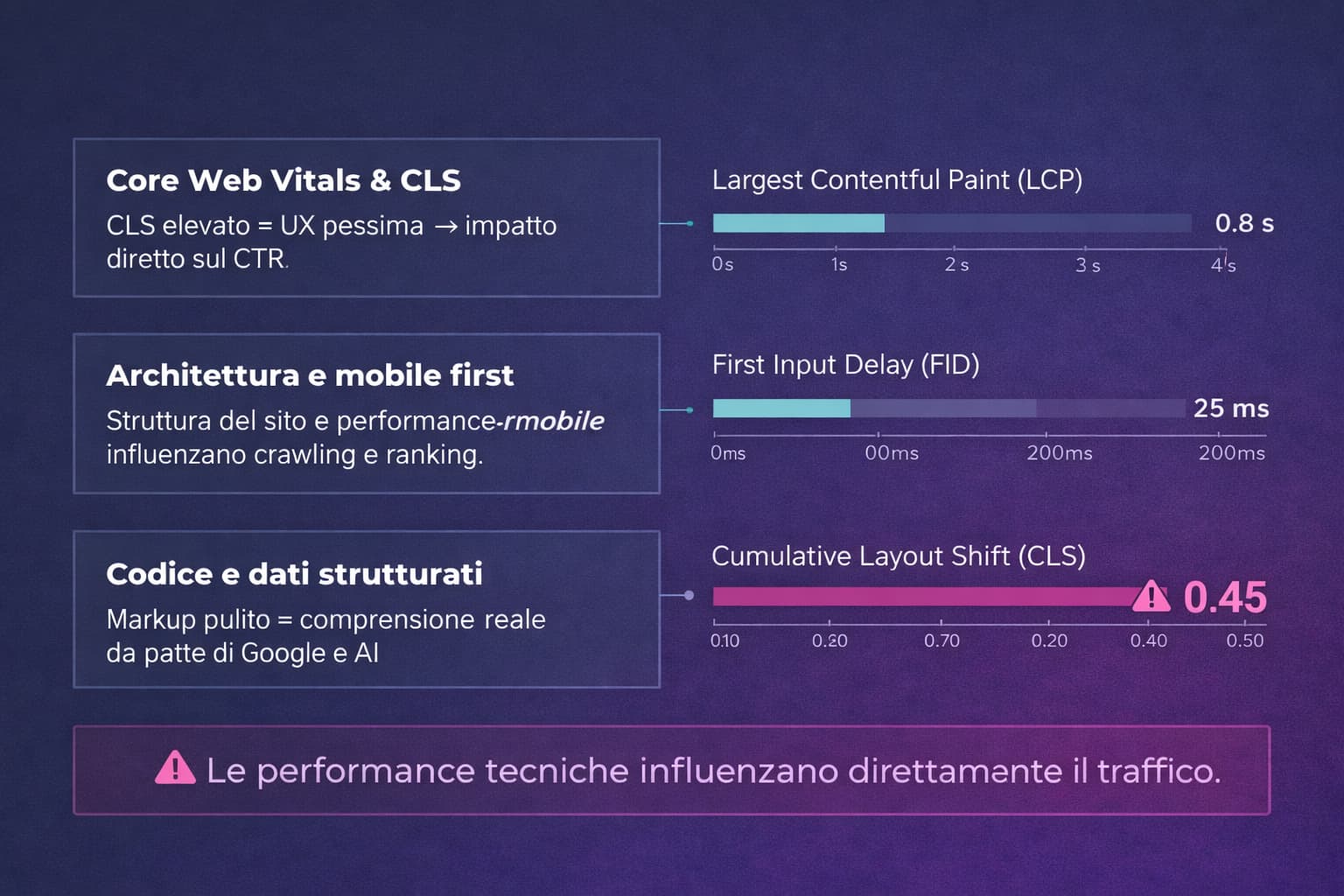

Core Web Vitals e metriche di performance

I Core Web Vitals rappresentano l’insieme di parametri tecnici attraverso i quali Google misura la qualità dell’esperienza utente di un ecommerce in termini di velocità di caricamento, reattività e stabilità visiva. La loro rilevanza per il posizionamento organico è ormai consolidata: non si tratta di metriche accessorie, ma di segnali qualitativi che incidono direttamente sulla capacità di un dominio di competere nelle pagine dei risultati.

Il Cumulative Layout Shift misura la stabilità visiva di una pagina durante il caricamento, rilevando gli spostamenti imprevisti degli elementi dell’interfaccia. Un valore elevato di questo indicatore genera un’esperienza disorientante per l’utente — elementi che si spostano mentre si legge o si interagisce con la pagina — con conseguenze dirette sul tasso di abbandono. La correzione di questa criticità si ottiene tramite l’assegnazione di dimensioni fisse ai contenitori e la definizione di spazi riservati per banner dinamici e contenuti caricati in modo asincrono, in modo che il layout rimanga stabile indipendentemente dalla velocità di connessione del dispositivo.

Il Largest Contentful Paint misura invece il tempo necessario alla visualizzazione dell’elemento principale della pagina — tipicamente un’immagine hero o un blocco di testo prominente. Una prestazione insufficiente su questo parametro erode la credibilità percepita del sito e incrementa il tasso di abbandono prima ancora che l’utente abbia avuto modo di valutare l’offerta. Il miglioramento dell’LCP dipende da una gestione efficiente delle risorse critiche: ottimizzazione delle immagini, riduzione dei tempi di risposta del server e prioritizzazione del caricamento degli elementi above the fold.

Una tecnica complementare per migliorare la velocità percepita — distinta dalla velocità effettiva — è quella degli skeleton screen: versioni scheletriche dell’interfaccia che si rendono visibili durante il caricamento dei dati reali, comunicando all’utente che la pagina è attiva e in fase di costruzione. Questa soluzione riduce il rischio di abbandono nelle fasi di attesa, ma richiede che i segnaposto rispettino con precisione le dimensioni degli elementi definitivi, per evitare di introdurre nuovi problemi di layout shift al momento della sostituzione con i contenuti reali.

Il contesto in cui tutte queste ottimizzazioni assumono la massima rilevanza è quello della navigazione mobile. La politica mobile-first indexing di Google stabilisce che sia la versione per smartphone del sito — e non quella desktop — l’elemento primario su cui il motore di ricerca fonda la propria valutazione. Con il traffico da dispositivi mobili ormai prevalente in quasi tutti i settori, qualsiasi carenza nell’esperienza mobile si traduce in una perdita misurabile di visibilità organica e, a cascata, in una contrazione delle conversioni e del fatturato.

L’impatto dell’AI sul calo di traffico di un ecommerce

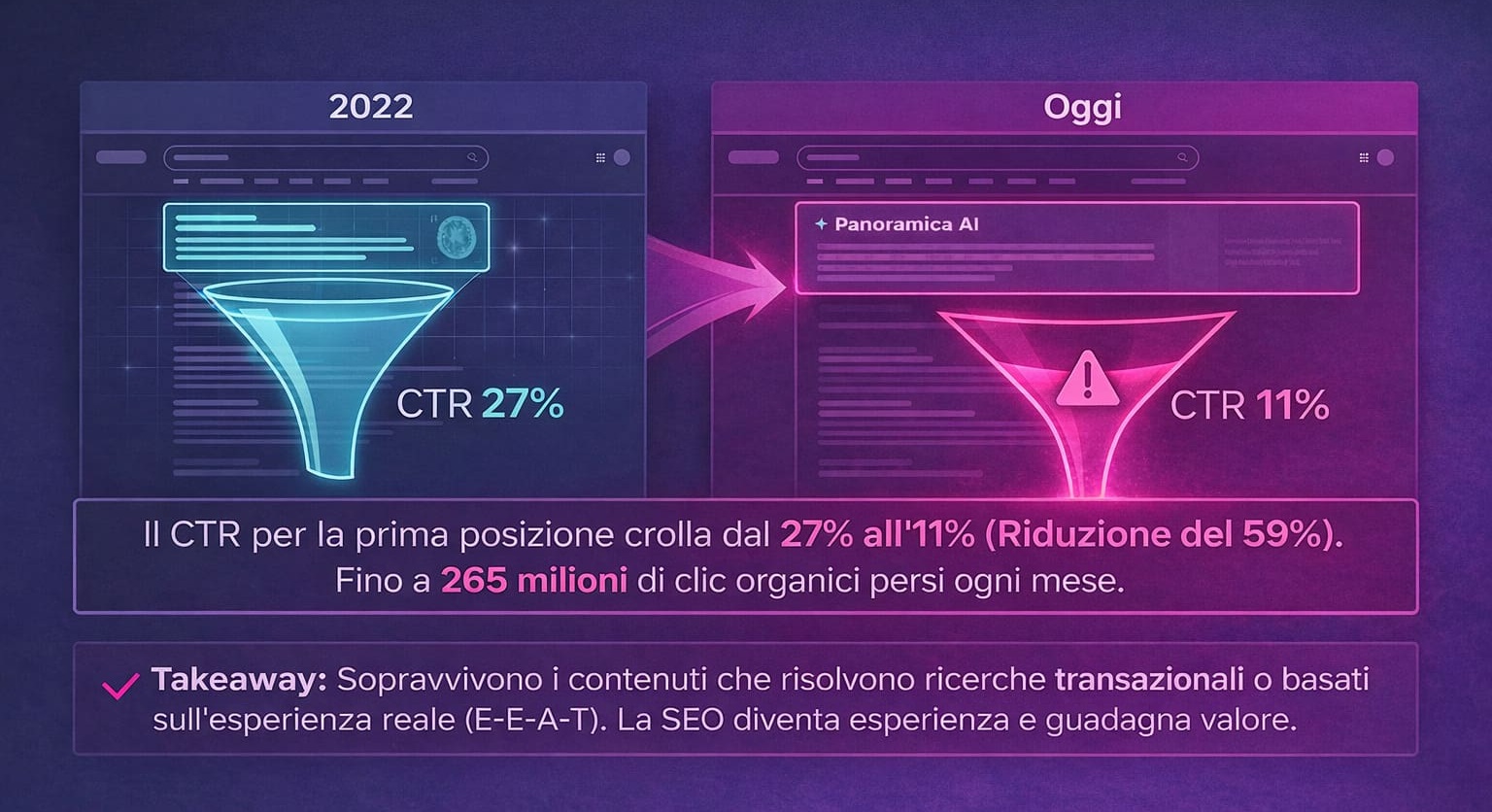

Le AI Overviews rappresentano un mutamento strutturale nell’esperienza di ricerca. In questo scenario, Google elabora e sintetizza le informazioni direttamente nelle pagine dei risultati. Questa evoluzione riduce il volume dei clic organici verso i siti web. I dati indicano che queste caselle di risposta compaiono ormai nel 20% delle ricerche e abbattono il tasso di clic sulla prima posizione dal ventisette all’undici per cento. La perdita del 59% dei clic dimostra come il motore di ricerca soddisfi l’esigenza informativa dell’utente senza la necessità di una visita esterna.

Le ricerche di tipo informativo, come quelle dedicate alla salute o alle guide pratiche, subiscono l’impatto maggiore perché la sintesi dell’intelligenza artificiale esaurisce il bisogno dell’utente in modo immediato. Al contrario, i settori transazionali come l’ecommerce e i viaggi dimostrano una resilienza superiore. Le attività di acquisto o prenotazione richiedono infatti una interazione diretta che i sistemi generativi non possono sostituire.

La Generative Engine Optimization (GEO) è la nuova frontiera per assicurare la visibilità del brand all’interno delle risposte prodotte dai modelli linguistici. Questa strategia impone un focus sulla creazione di contenuti originali e sull’uso di dati proprietari. L’obiettivo risiede nella capacità del sito di farsi selezionare come fonte autorevole dai sistemi di intelligenza artificiale, i quali scartano l’ottantacinque per cento delle pagine consultate durante la generazione della risposta.

La Share of Answer si afferma come la metrica fondamentale per misurare l’influenza di un marchio nelle sintesi generative. Essa monitora la frequenza con cui il brand appare come riferimento affidabile nelle risposte fornite agli utenti. Tale parametro sposta l’attenzione dal semplice volume di traffico alla capacità del sito di presidiare i temi chiave del proprio settore come entità riconosciuta e citata.

Nell’era dell’intelligenza artificiale, la reputazione esterna raccolta attraverso recensioni e citazioni editoriali costituisce la cosiddetta commercial proof. I sistemi generativi non valutano pagine isolate ma analizzano la credibilità complessiva di un’entità in base ai segnali diffusi sul web. La prova concreta che il mercato scelga realmente un brand diventa un fattore decisivo per ottenere raccomandazioni dai motori di risposta.

Come prevenire ulteriori cali di traffico organico dell’ecommerce

La SEO Audit deve essere inteso come un’attività periodica e non come un intervento isolato. La ripetizione dell’analisi ogni 6-12 mesi permette di intercettare tempestivamente le anomalie derivanti dai frequenti aggiornamenti degli algoritmi di ricerca. Per i progetti editoriali che superano i 500 URL, la frequenza semestrale è un requisito indispensabile per il mantenimento della competitività. Questa ciclicità assicura che l’architettura del sito e la strategia dei contenuti restino allineate alle evoluzioni tecnologiche e alle variazioni degli intenti di ricerca degli utenti. Un controllo costante trasforma la SEO per ecommerce in una leva di crescita strategica capace di prevenire perdite di visibilità prima che queste diventino irreversibili.

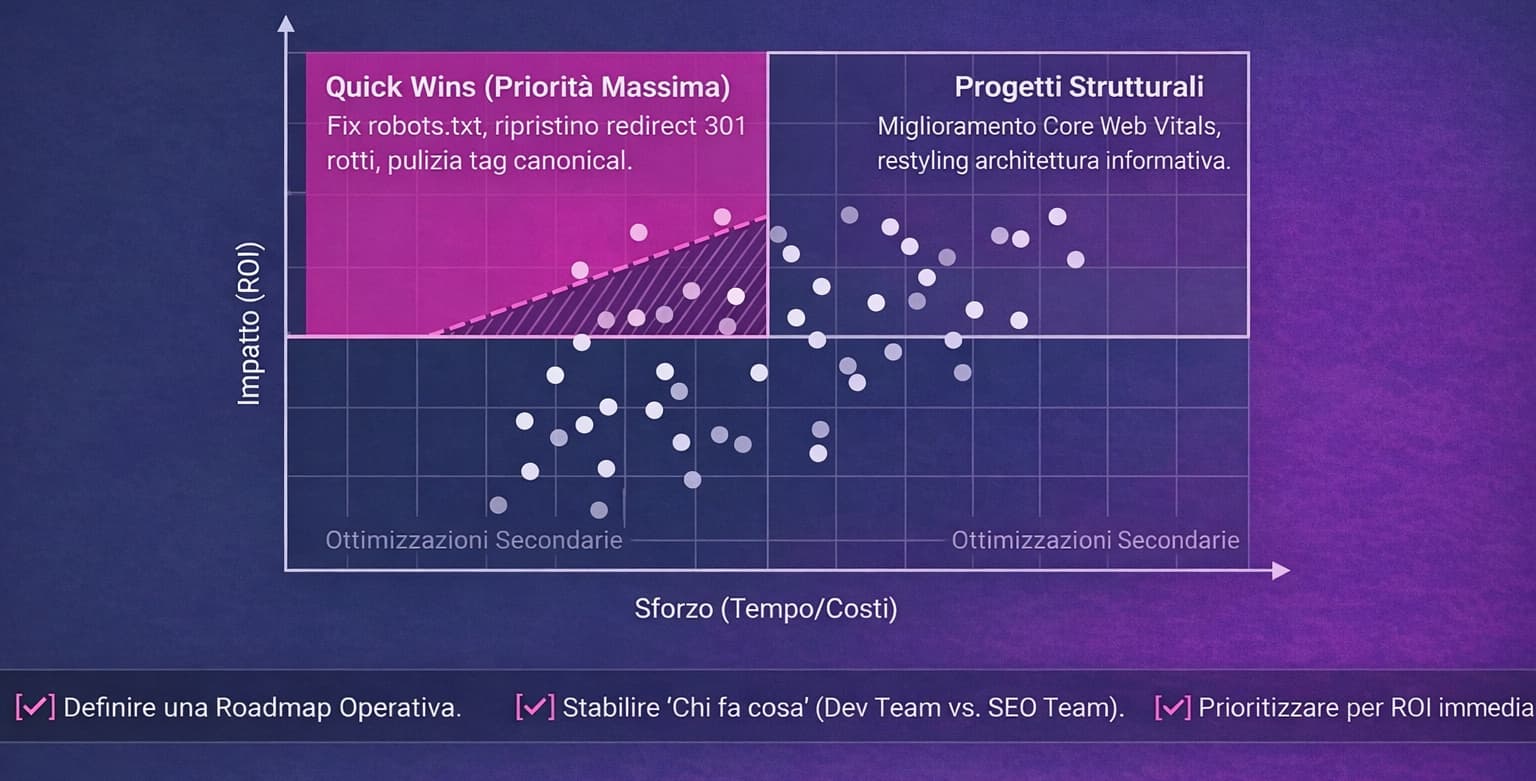

Il piano d’azione finale si conclude con la consegna di documenti analitici progettati per guidare le scelte dei decision-maker. L’Executive Brief sintetizza le priorità assolute e i rischi critici in un formato accessibile ai vertici aziendali. La roadmap operativa suddivide gli interventi in “quick wins” ad alto impatto immediato e in azioni strutturali di lungo periodo. Ogni problematica rilevata riceve un indice di criticità e una spiegazione accompagnata da esempi pratici per facilitare il lavoro del team di sviluppo. Infine, il documento include una serie di KPI suggeriti per monitorare l’efficacia delle correzioni attraverso una verifica rigorosa dei dati pre e post implementazione.